AIデータセキュリティ

グローバル企業がクラウド基盤でAIエージェントを構築する際の、セキュリティとデータガバナンスの全体像。データ主権と通信の秘匿化を軸に、安全なAI運用を実現します。

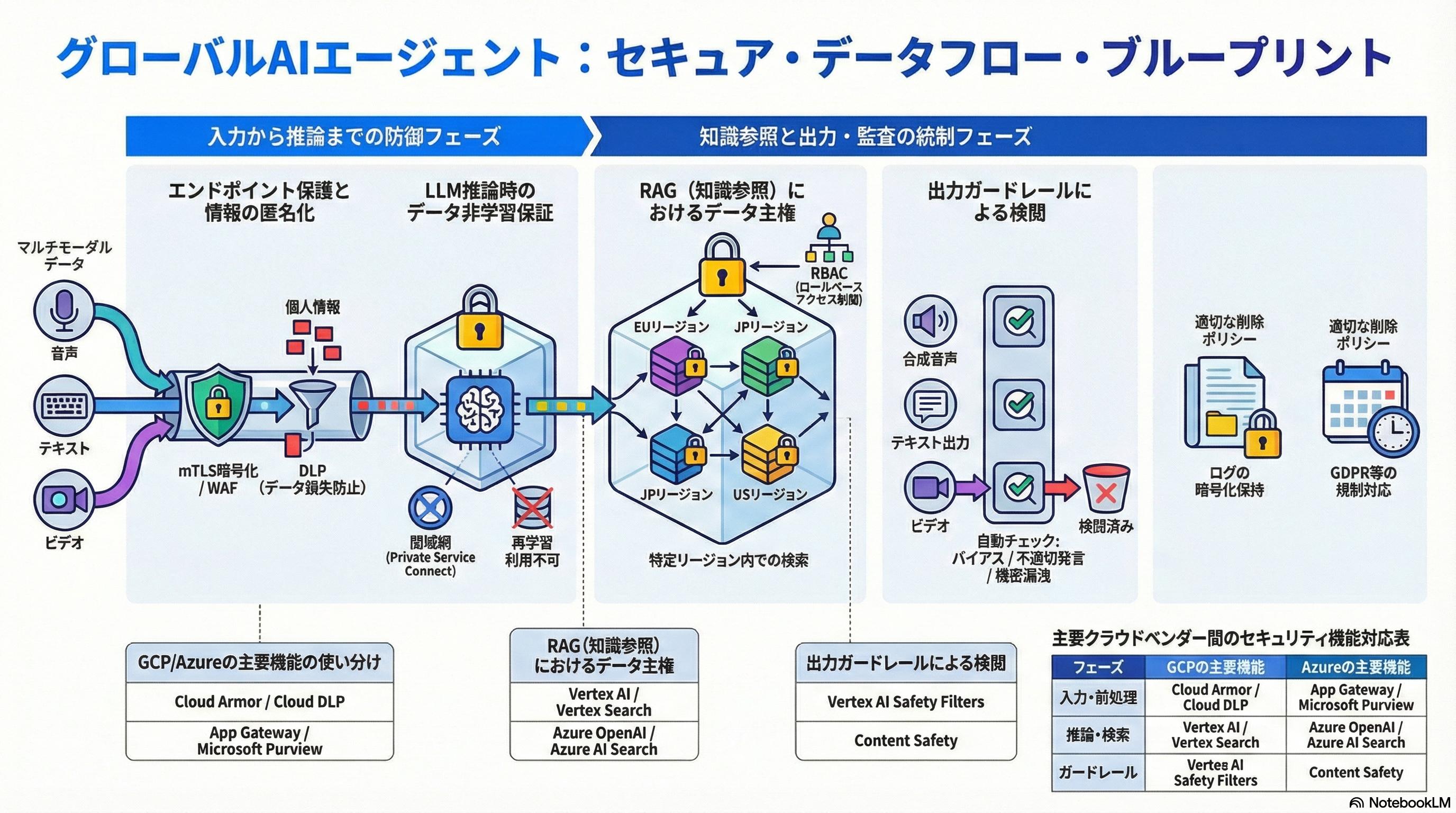

セキュア・データフロー・ブループリント

テキスト・音声・ビデオを含むマルチモーダルAIエージェントの標準的なデータフローと、各フェーズにおけるセキュリティ対策

入力から推論までの防御フェーズ(左)と、知識参照・出力・監査の統制フェーズ(右)を一貫して管理

セキュリティ視点でのデータフロー管理

AIエージェントが処理するデータの各フェーズにおけるセキュリティ対策とクラウド機能

| フェーズ | データ形式 | セキュリティ/プライバシーの勘所 | GCP | Azure |

|---|---|---|---|---|

|

1

入力(Ingress)

|

テキスト, 音声, ビデオ | エンドツーエンド暗号化(mTLS)、WAFによるDDoS保護、音声/ビデオのストリーミング認可。 | Cloud Armor, Apigee | App Gateway (WAF), API Management |

|

2

前処理

|

波形, フレーム, 文字 | センシティブ情報のマスキング(DLP)。PII(個人情報)をモデルに渡す前に除去。 | Cloud DLP | Microsoft Purview |

|

3

推論(LLM)

|

プロンプト, Embeddings | データの非学習保証。入力データがモデルの再学習に使用されない設定の確認。 | Vertex AI (Private Service Connect) | Azure AI Services (Private Endpoint) |

|

4

知識参照(RAG)

|

社内ドキュメント, DB | データレジデンシー。特定リージョン内での検索。アクセス権限(RBAC)の継承。 | Vertex AI Search, Cloud Storage | Azure AI Search, Blob Storage |

|

5

出力(Egress)

|

テキスト, 合成音声 | 出力ガードレール。不適切な発言、バイアス、機密情報の漏洩チェック。 | Vertex AI Safety Filters | Content Safety |

|

6

保存・監査

|

ログ, 会話履歴 | 監査ログの暗号化と保持ポリシー。グローバルな法規制(GDPR等)に基づく削除対応。 | Cloud Logging, BigQuery | Azure Monitor, Log Analytics |

入力(Ingress)

テキスト, 音声, ビデオ

エンドツーエンド暗号化(mTLS)、WAFによるDDoS保護、音声/ビデオのストリーミング認可。

前処理

波形, フレーム, 文字

センシティブ情報のマスキング(DLP)。PII(個人情報)をモデルに渡す前に除去。

推論(LLM)

プロンプト, Embeddings

データの非学習保証。入力データがモデルの再学習に使用されない設定の確認。

知識参照(RAG)

社内ドキュメント, DB

データレジデンシー。特定リージョン内での検索。アクセス権限(RBAC)の継承。

出力(Egress)

テキスト, 合成音声

出力ガードレール。不適切な発言、バイアス、機密情報の漏洩チェック。

保存・監査

ログ, 会話履歴

監査ログの暗号化と保持ポリシー。グローバルな法規制(GDPR等)に基づく削除対応。

グローバル展開における3つの重要ポイント

データ主権と通信の秘匿化を軸に、グローバルAIエージェントを安全に運用するための要点

ネットワークの隔離

AIエージェントとLLM、社内データベース間の通信をインターネットに出さない構成が必須です。

VPC Service Controls でVertex AI へのアクセスを特定プロジェクト内のみに制限

Private Endpoint でVNet内部のプライベートIPのみで全通信を完結

データレジデンシー

欧州や中国など、データ移動に厳しい制限がある地域では、モデルの推論地点とデータの保存場所を一致させる必要があります。

各リージョン(東京、ベルギー、米国など)ごとにエンドポイントを構築し、グローバルなトラフィックマネージャーでユーザーに近い拠点へ振り分け

音声・ビデオデータ

音声

WebRTC等のプロトコルで、シグナリングとメディアデータの両方をSRTP等で暗号化しているかの確認が必要

ビデオ

会議プラットフォーム(Teams, Zoom, Google Meet)との連携で、録画データの保存場所を自社管理ストレージに限定することを推奨

クラウドベンダー間のセキュリティ機能対応表

GCPとAzureの主要セキュリティ機能を各フェーズごとに比較

Google Cloud Platform

Microsoft Azure

エンタープライズ契約に関する注意

GCPもAzureも、デフォルト設定では「入力したデータは再学習に使われない」としていますが、エンタープライズ契約(Enterprise Agreement)の適用状況を必ず法務・IT部門と再確認してください。契約内容によって、データの取り扱いポリシーが異なる場合があります。

Lifegence Approach

Lifegenceのセキュリティ対策

Lifegence Company OSは、上記のセキュリティベストプラクティスを組み込んだ設計を採用しています。テナント分離、通信暗号化、出力ガードレールなど、多層的な防御でお客様のデータを保護します。

テナント完全分離

Docker基盤のSite-per-Tenantアーキテクチャで物理的にデータを隔離。

AIセキュリティパイプライン

8段階のセキュリティチェックをすべてのAIリクエストに適用。

通信の完全暗号化

mTLS / TLS 1.3でエンドツーエンドの暗号化を実現。

監査ログと法規制対応

全操作の監査ログ記録とGDPR・個人情報保護法への準拠。

Lifegenceの防御レイヤー

WAF / DDoS保護 / IP制限

mTLS / Rate Limit / RBAC

AES-256暗号化 / DLP / テナント分離

非学習保証 / ガードレール / ハルシネーション検知

全操作ログ / GDPR対応 / 改ざん防止

AIデータセキュリティについて詳しく知りたいですか?

セキュリティアーキテクチャの詳細、コンプライアンス対応状況、お客様環境に合わせた構成のご相談はお気軽にお問い合わせください。